从GPU历史演进,谈信号分析识别用什么GPU?

前言

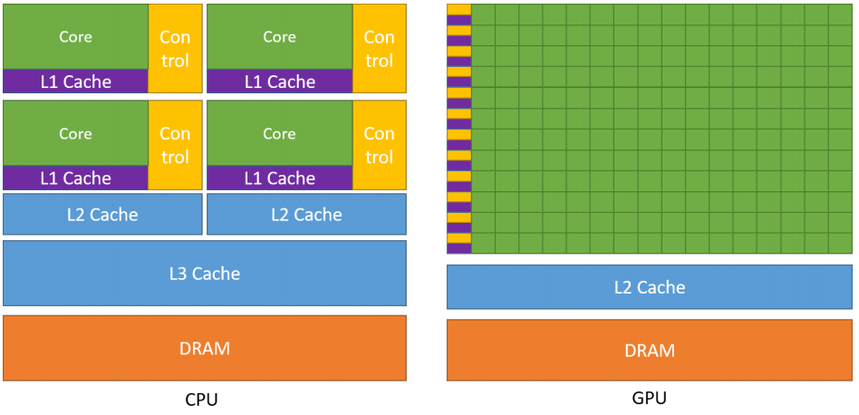

近年来AI新技术开始在各个领域进行推广和应用,在信号分析识别领域也不例外。基于AI的技术方案,可有效改进信号分析识别中的多个老难题,因此也得到了普遍关注。但采用AI技术也引入了新问题,就是具体如何实现和运行AI神经网络的问题。传统的、天生串行处理的CPU并不是运行AI神经网络的最佳选择,采用支持并行运算的GPU/NPU才是更为合理的策略和方案。

图1 十多年前英伟达演示CPU与GPU的区别(强调并行的效率)

然而,GPU/NPU厂商众多,尤其是近年来随着国产化的发展大趋势,国内涌现出数量众多的相关厂商,也给出了类型繁多,功能特性各异的技术方案。如何根据信号分析识别的应用场景和对应硬件设备的功能特性,合理的选择GPU/NPU也就提上了日程。

本文首先分析AI在信号分析识别领域的典型应用场景,结合GPU/NPU的历史演进,分析比较几个国内外主流厂商的产品,并指出其当前面临的问题和缺陷,最终给出一套适用于信号分析识别系统的中心端/边缘端的参考方案。

GPU/NPU在信号分析识别中能干啥?

信号分析可简单归纳为检测识别、解调解码两个大的技术方向,分别解决信号是什么,在干啥两个基本问题。

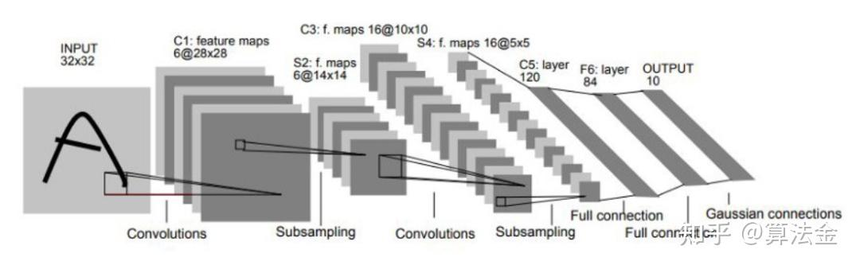

GPU/NPU最能大展拳脚的就是信号的检测识别方向,相对于传统的特征选+特征提取+分类器方案,AI神经网络的检测识别效果明显优于决策树/支撑矢量机等传统分类器。诸如信号分选、电磁环境自动识别、信号检测、干扰检测、调制类型识别、传输体制类型识别、干扰类型识别等典型信号分析识别应用场景,AI技术均大有用武之地。

图2 图灵奖获得者Yann LeCun提出的CNN LeNet-5用于手写数字识别

另外,在一些特定领域,AI也可发挥重要作用,起到简化处理流程、提升检测结果的作用,比如基于AI的黑广播检测,除了采用语音转文本,文本内容分类的双AI处理流程方案外,直接根据语音输入进行黑广播鉴别的单AI模型方案也逐渐成熟起来。在解调解码方向,AI应用较少,还无法做到替代传统的载波同步/符号同步/解调解码方案。

以上描述的是信号分析识别物理层的几个典型应用,主要还是集中在信号层面。在更为上层的信息处理方面,AI的应用面非常广泛,限于篇幅不再展开描述。

值得一提的是,虽然GPU主要用于实现AI算法,但由于其天生擅长并行计算的特性,也可用于各种信号处理算法的加速处理,诸如用于扫频的频谱计算,用于瀑布图显示的短时FFT计算,用于信号提取的DDC滤波抽取计算等,只要涉及大量乘累加计算的场景,均可借助GPU加速。注意这些加速计算场景只提到了GPU,并没有提到NPU,后续章节会详细解释。

GPU/NPU的历史演进

GPU(图形处理单元,Graphics Processing Unit)这个概念于1999年由美国3D游戏芯片厂商NVIDIA(英伟达)提出。在1999年,NVIDIA推出了一款名为GeForce 256的芯片,并首次使用这个术语来描述它。

图3 世界上第一个GPU GeForce 256

NVIDIA宣称,GeForce 256能将图形几何变换、光照计算等多个图形处理任务整合到一个芯片中,从而大大减轻CPU的负担。这款芯片是NVIDIA公司商业和技术成功道路上的一个里程碑,进一步奠定了该公司在全球3D游戏图形处理芯片的霸主地位。

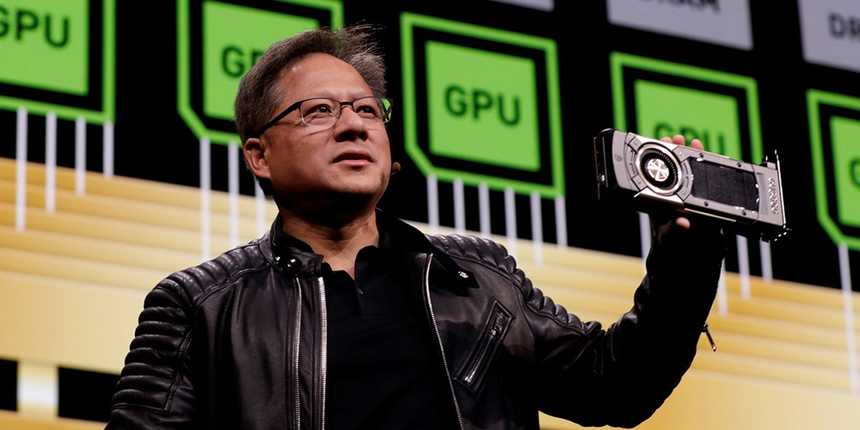

图4 老黄与他的GPU

进入21世纪后,NVIDIA坐稳全球3D游戏图形处理芯片的第一把交椅后,遇到了进一步发展壮大的瓶颈。相对于英特尔的CPU市场来说,全球游戏市场规模还是小了很多。NVIDIA亟需扩大其图形显示芯片的应用场景和范围,因此于2006年提出通用并行计算架构CUDA(Compute Unified Device Architecture),尝试进军通用计算领域。

图5 运算GPU并非独立计算平台,需与CPU协同工作,可视为CPU的协处理器

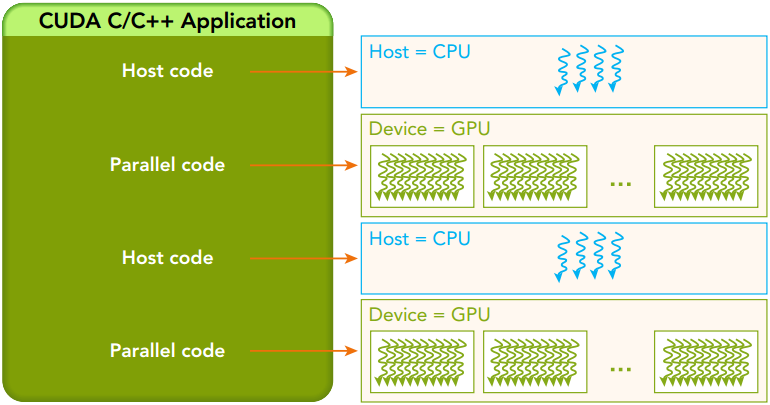

NVIDIA的CUDA其实就是一套软件开发平台,目的就是为非游戏开发领域的软件开发者提供一种相对容易上手的编程接口(支持C /C++ 语言),让非计算机图形处理方向的、更为广大的软件开发者也能很方便的使用GPU。

图6 CUDA中,host指CPU及内存,device指GPU及内存,程序分host和device部分,分别在CPU和GPU上运行

由于英特尔的x86 CPU已经构建了强大的产业生态,CUDA诞生之初的几年,并没有撼动英特尔的市场地位。GPU擅长并行计算,因此只是在科学计算/并行计算领域获得了应用和重视,其影响力和市场规模并没有多大。

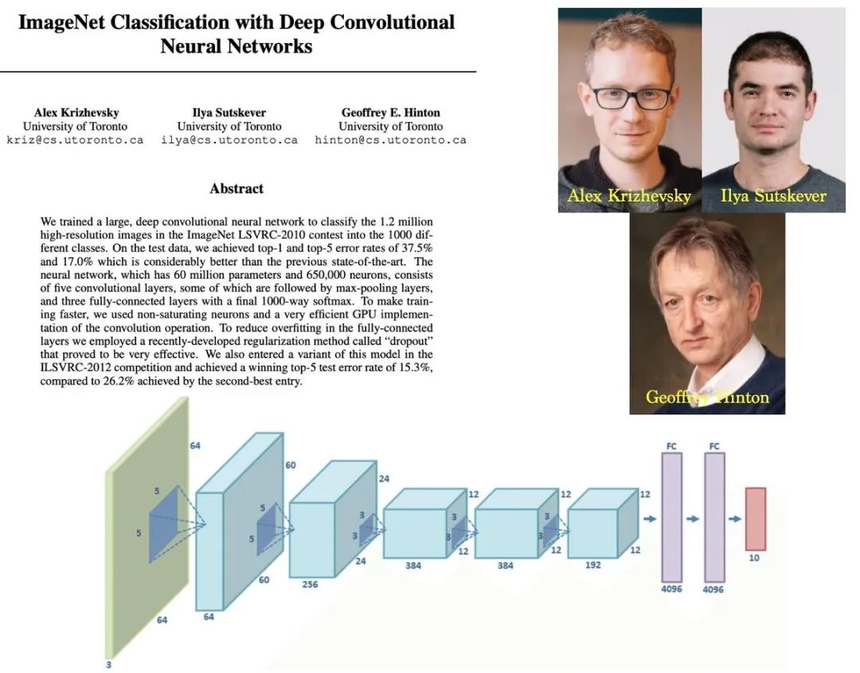

时间来到2012年,在这一年举行的全球ImageNet图像识别大赛上,Alex Krizhevsky(图灵奖和诺贝尔奖获得者,深度学习之父Geoffrey Hinton领导的团队成员之一),基于两块NVIDA的GPU(GeForce GTX 580),采用深度神经网络技术方案,夺得了第一名的佳绩,同时相对前几年识别率提升缓慢的现状,图形识别准确率明显提升了一大截,这使得模式识别领域的人们看到了新的曙光和方向。

图7 深度卷积神经网络AlexNet在当年ImageNet大规模视觉识别挑战赛(ILSVRC)中以显著优势夺得冠军

2016年,AlphaGo战胜全球围棋冠军李世石,是AI发展的一个里程碑事件,使得AI从专业领域的小有名气变成妇孺皆知,第三次AI浪潮也就此兴起。神经网络大多都是并行算法,大家环顾四周,发现只有NVIDA的GPU适合这种并行计算。

图8 Alphago以 4:1的成绩击败李世石

围绕CUDA默默修炼10年苦功的NVIDA,终于迎来了收获丰硕果实的时刻,营收也开始爆发性增长,直至成长为全球市值最大的公司。下图展示了NVIDA GPU的演进历史,该图也再次充分证明:机会偏爱那些做好准备的人。

图9 NVIDIA GPU演进

2016年之后,其它厂商也注意到AI神经网络对并行计算的强烈需求,开始研制适合AI应用的专用芯片,后来统称为NPU(Neural Processing Unit)。比如谷歌自研的TPU,众多嵌入式SOC厂商开始在其芯片内部集成神经网络计算单元,国内也涌现出几十个NPU厂商,一时间令人眼花缭乱,也给用户的选择带来了更多的困扰。

图10 谷歌新一代Ironwood TPU可在单个集群中连接多达9,216颗芯片

英伟达的GPU

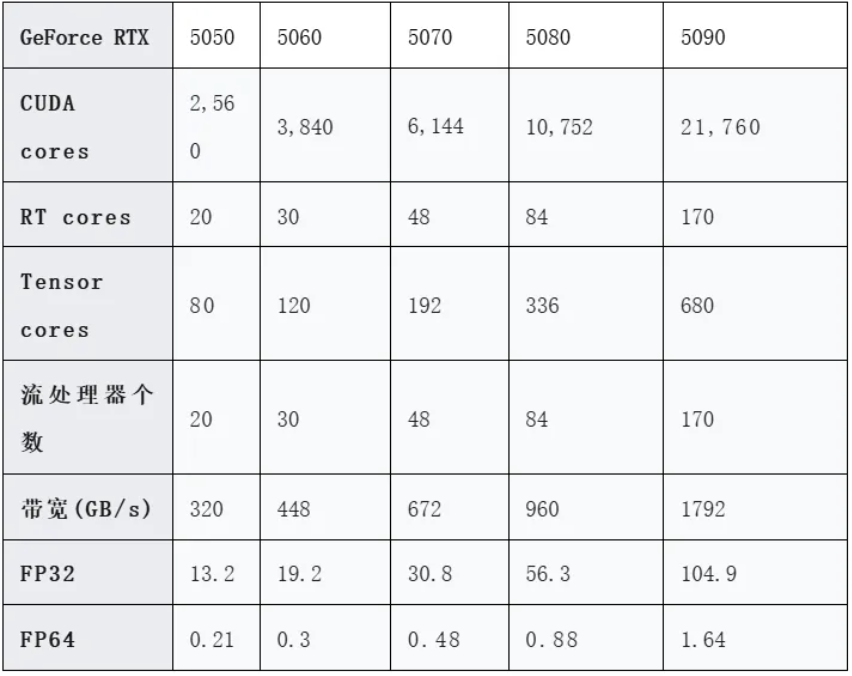

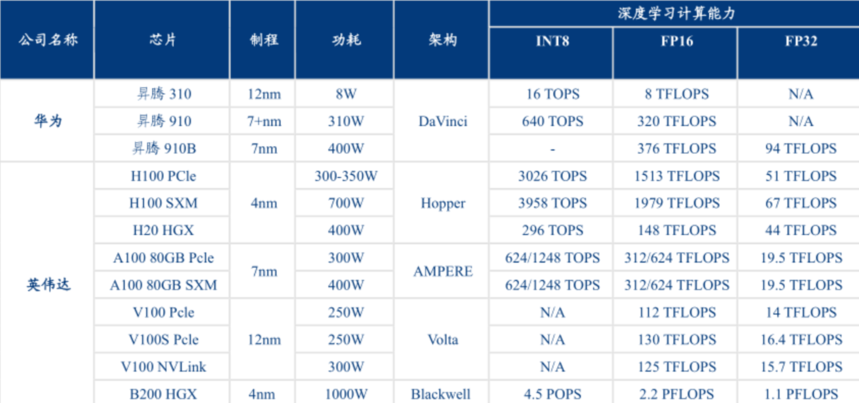

接近二十年的持续积累后,NVIDIA构建了极为强大的技术与产业生态。便于软件人员使用的CUDA开发平台,更是形成了强大的护城河,使其在AI计算平台领域处于绝对垄断地位。因此在不考虑国产化的前提下,NVIDIA就是第一选择。不论在中心端还是边缘端,不论是面向企业领域还是消费领域,都提供了丰富的产品供客户选择和使用。最新一代的GPU主要算力指标如下表所示。

表1 NVIDIA 5000系列GPU规格

在中心端,NVIDIA新一代的Blackwell也开始在市场大面积铺开。虽然针对我国的型号进行了功能性能裁剪,但仍是进行AI模型研发的优先选择对象,尤其是在运算量巨大的训练阶段。严格来讲,中心端这些芯片不能称之为GPU了,因为其主要用于AI场景,已经裁剪了图形处理相关功能。下图为已经发布很长时间的用于训练的Ampere系列和Hopper系列主要指标参数。

表2 NVIDIA Tesla系列功能参数

规格 | A100 | A800 | H100 | H800 |

FP64 | 9.7/19.5 | 9.7 | 34/67 | 25.6 |

FP32 | 19.5 | 19.5 | 67 | 51.2 |

TF32 | 156 | 144 | 989 | 720 |

FP16 | 312 | 288 | 1979 | 1450 |

FP8 | \ | \ | 3958 | 2900 |

华为的NPU

基于AI对算力的强烈需求以及国际禁运的限制,华为推出了自研的NPU芯片产品,即昇腾系列。其中昇腾310系列是面向边缘端,昇腾810系列面向中心端。

图11 昇腾384超节点:以超节点架构+总线技术,实现384个NPU大带宽低时延互联

受限于半导体工艺和技术积累水平,昇腾在硬件算力上落后NVIDIA约2代,在应用/软件生态和用户规模上则差距更大。NVIDIA在并行计算领域近20年的持续积累,短时间难以迅速赶超,但华为在通信系统领域的强大战斗力让其成长趋势不可小觑。下图为昇腾与NVIDIA的主要性能对比。

图12 华为昇腾与NVIDIA参数对比

摩尔线程的GPU

摩尔线程是国内目前相对最成熟、最接近NVIDIA产品的一家专用GPU厂商。

图13 摩尔线程MTT S4000:支持多卡互联及千卡集群,加速千亿参数大语言模型计算

与NVIDIA的Tensor Core类似,MTT S4000系列支持FP64、FP32、TF32、FP16、BF16、INT8等主流精度算力。以便用于大语言模型(LLM)的训练、微调和推理计算。摩尔线程的两个主流GPU产品系列性能指标如下图所示。

表3 摩尔线程的主流GPU参数

参数 | S4000 | S80 |

流处理器个数 | 8192 | 4096 |

FP32 | 25 TFLOPS | 14.7 TFLOPS |

TF32 | 50 TFLOPS | / |

FP16 | 100 TFLOPS | / |

INT8 | 200 TOPS | / |

内存大小 | 48 GB | 16GB |

内存带宽 | 768 GB/秒 | 448GB/s |

功耗 | 450瓦 | 255W |

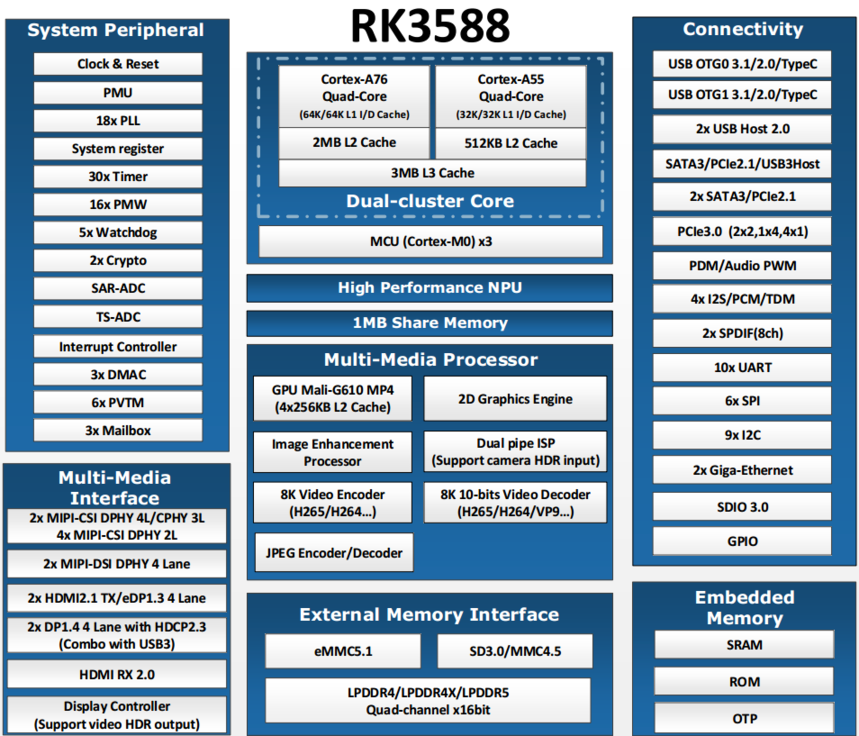

瑞芯微的SOC

瑞芯微的RK3588系列,是一款SOC芯片。该芯片集成了ARM架构的4核A76,4核A55,同时集成一个6Tops算力的NPU。

图14 RK3588系列核心板

因体积小,功耗低,接口丰富,很适合低功耗的边缘端场景应用。可基于该NPU运行一些轻量级神经网络,实现信号检测、信号识别等功能。下图为该SOC的主要组成,可以看到,内部集成CPU/GPU/NPU/VPU等多个模块,非常适合便携式/手持式产品的应用。

图15 瑞芯微RK3588 SOC的组成

结论

通过以上几个主流GPU/NPU的对比,可以得出以下结论:

(1)若无国产化要求,则首选NVIDIA。无论是其硬件芯片的算力,还是对应软件平台的易用性,都是行业内的标杆。主流深度学习框架对其的匹配也是最佳的。

(2)对于有国产化要求的场景,中心端可考虑昇腾910系列;边缘端可考虑瑞芯微系列。由于国产化产品技术和生态积累时间有限,开发调试过程中会遇到不少问题,但随着国产化厂商的不断打磨,这些问题会逐步收敛。

(3)大多数国产NPU,通常只支持AI模型运算。对单精度浮点/双精度浮点运算支持力度很弱。若希望替代CPU,通过GPU完成FFT/FIR等科学计算,则需要摩尔线程GPU。华为昇腾310系列和瑞芯微的NPU缺乏对浮点计算的有力支撑。

(4)受限于半导体先进工艺和技术积累水平,国产GPU/NPU仍大幅度落后国际一线大厂NVIDIA。尤其是在构建类似CUDA这样性能强大、完善易用的软件平台和开发生态,更是国内众多GPU/NPU厂商需要亟需弥补和追赶的关键能力。

关于祯仪

祯仪科技,专业从事宽频段无线电信号接收,适用于无线电管理、信号侦查与分析、通用频谱分析、卫星导航监测、低空复杂电磁环境感知等。

Recommend

-

-

QQ Zone

-

Sina Weibo

-

Renren.com

-

Douban